Google CALM چیست؟

فناوری جدید گوگل به اسم Google CALM که برای بهبود سطح عملکرد مدلهای زبان بزرگ مانند GPT-3 و LaMDA کارایی دارد را معرفی کرد.

گوگل کالم یک فناوری نوآورانه به نام Confident Adaptive Language Modeling یا همان CALM است که در این مقاله از بلاگ سلکتک به آن پرداخته ایم.

این تکنولوژی مدل سازی زبان تطبیقی مطمئن می تواند سرعت مدل زبانی بزرگ را تا سه برابر بهبود بخشد.

در ادامه بیشتر رابطه با نحوه کار آن توضیح خواهیم داد.

با ما همراه باشید.

اهمیت داده برای مدل های زبان

مدلهای زبان بزرگ (LLM) توسط مقادیر زیادی داده و اطلاعات آموزش میبینند.

آموزش مدلهای زبان بر روی مقادیر بیشتر داده منجر به یادگیری تواناییهای جدیدی در مدلی میشود که ممکن است برای آنها برنامهریزی نشده است.

یک مدل زبان ممکن است برای کاری آموزش ندیده باشد اما با افزودن داده های بیشتر به این مدل در رابطه با ترجمه زبانها، میتوانید به طور غیرمنتظرهای منجر به کسب توانایی ترجمه بین زبانهای مختلف در آن شوید.

این تواناییهای جدید، تواناییهای نوظهور نامیده میشوند، تواناییهایی که لزوماً برای آنها برنامهریزی نشدهاند.

تاثیر داده های زیاد بر Language Modeling

اگر دهها نمونه از تواناییهای نوظهور وجود دارد، اما در حال حاضر توضیحات قانعکنندهای برای اینکه چرا چنین تواناییهایی به شیوهای که پیدا میشوند، وجود دارد.

نمی توان کامل توضیح داد که چرا توانایی های مختلف توسط مدلهای زبان آموخته می شوند.

اما میدانیم افزایش حجم داده برای آموزش ماشین به آن اجازه می دهد تا توانایی های بیشتری به دستآورد.

نقطه ضعف افزایش مقیاس دادههای آموزشی این است که برای تولید یک خروجی به توان محاسباتی بیشتری نیاز است و این موضوع باعث میشود هوش مصنوعی در زمانی که خروجی متن تولید میکند کندتر شود.

پیشرفتهای اخیر در مدلهای زبان بزرگ مبتنی بر Transformer (LLM) منجر به بهبود عملکرد قابل توجهی در بسیاری از وظایف آنها شده است.

این دستاوردها با افزایش شدید اندازه مدلها همراه است و به طور بالقوه منجر به استفاده آهسته و پرهزینه در زمان استنتاج میشود.

مدل سازی زبان تطبیقی مطمئن (CALM)

از نظر محاسباتی، مدلهای زبان بزرگ تفاوتی بین بخش سخت یک کار تولید متن و بخش آسان قائل نمیشوند.

درنتیجه متخصصان گوگل دریافتند که مدل های زبان از لحاظ سرعت و عملکرد نیازمند بهینهسازی هستند. مشکل اصلی این بود که این مدل ها برای پاسخ به سؤال آسان و سخت تفاوتی قائل نبودند.

آنها متن را برای هر دو بخش آسان و دشوار با استفاده از قدرت محاسباتی کامل خود در زمان استنتاج تولید می کنند.

در نتیجه نسبت به نیاز برای یافتن جواب هر سؤال، زمان و تحلیل صرف شود.

راه حل گوگل مدلسازی زبان تطبیقی مطمئن یا CALM نام دارد.

Confident Adaptive Language Modeling

در اصل Confident Adaptive Language Modeling منابع کمتری را به بخشهای بیاهمیت یک کار تولید متن اختصاص میدهد و تمام قدرت را برای بخشهای دشوارتر اختصاص میدهد.

در نتیجه زمان و هزینه کمتری برای تحلیل و استنتاج مصرف میکند.

با این حال، در عمل، سری از نسل های ساخته شده توسط LLM ها از سطوح مختلف دشواری تشکیل شده است.

در حالی که برخی پیشبینیها واقعاً از ظرفیت کامل مدلها سود میبرند، اما نکته مهم این است که اکنون مسائل میتوانند با محاسبات سادهتر حل شوند.

در حالی که مدل های بزرگ به طور کلی بهتر عمل می کنند، ممکن است برای هر ورودی برای دستیابی به عملکرد مشابه، مقدار یکسانی از محاسبات لازم نباشد.

Google CALM چگونه کار می کند؟

Google CALM با تخصیص پویا منابع بسته به پیچیدگی هر بخش کار، با استفاده از یک الگوریتم برای پیشبینی اینکه آیا سؤال کاربر به منابع کامل یا جزئی نیاز دارد، کار میکند.

این فناوری جدید برای کارهای مختلف پردازش زبان طبیعی، خلاصهسازی متن، ترجمه ماشینی و پاسخگویی به سوالات آزمایش شد و متوجه شدند که آنها میتوانند استنتاج را تا حدود 300% افزایش سرعت داشته باشد.

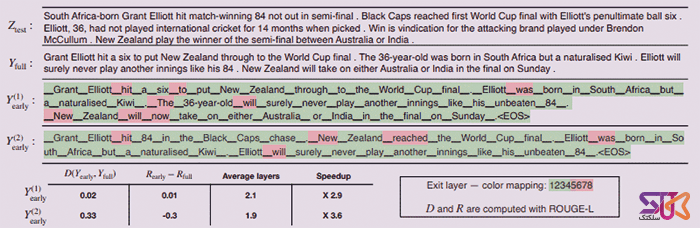

تصویر زیر نشان می دهد که سیستم CALM چقدر خوب کار می کند.

چند ناحیه قرمز رنگ نشان میدهد که دستگاه باید از ظرفیت کامل خود در آن بخش از کار استفاده کند.

مناطق سبز رنگ جایی هستند که دستگاه فقط کمتر از نیمی از ظرفیت را در آن استفاده کرده است.

قرمز = ظرفیت کامل

سبز = کمتر از نیم ظرفیت

تاثیر CALM بر افزایش سرعت مدل زبان بزرگ

در تصویر بالا رنگ ها تعداد لایه های رمزگشایی مورد استفاده برای هر نشانه را نشان می دهند - سایه های سبز روشن کمتر از نیمی از کل لایه ها را نشان می دهد.

فقط تعداد کمی از نشانه های انتخاب شده از ظرفیت کامل مدل استفاده می کنند (رنگ قرمز)، در حالی که برای اکثر توکن ها، مدل پس از یک یا چند لایه رمزگشایی (به رنگ سبز) خارج می شود.

محققان این مقاله را با ذکر این نکته به پایان رساندند که اجرای CALM تنها به حداقل تغییرات نیاز دارد تا بتواند یک مدل زبان بزرگ را برای سریعتر شدن تطبیق دهد.

این تحقیق مهم است زیرا راه را برای ایجاد مدلهای هوش مصنوعی پیچیدهتر باز میکند که بر روی مجموعه دادههای بزرگتر آموزش داده میشوند، بدون اینکه سرعت کمتری را تجربه کنند و در عین حال سطح عملکرد بالایی را حفظ کنند.

با این حال، ممکن است این روش بتواند برای مدلهای زبان بزرگی که بر روی دادههای کمتری نیز آموزش دیدهاند، سودمند باشد.

اهمیت Google CALM

به طور کلی، چارچوب محاسباتی تطبیقی کامل برای Large Language Models به حداقل تغییرات در مدل اساسی نیاز دارد و باعث افزایش کارایی می شود و در عین حال تضمین های کیفیت دقیق را برای خروجی برآورده می کند.

به عنوان مثال، مدلهای InstructGPT، که ChatGPT یک مدل خواهر و برادر از آنها است، بر روی تقریباً 1.3 میلیارد پارامتر آموزش داده شدهاند، اما همچنان میتوانند از مدلهایی که بر روی پارامترهای بسیار بیشتری آموزش دیدهاند، بهتر عمل کنند.

با توجه به ویژگی های جذاب آن، باید صبر کنیم تا ببینیم آیا این فناوری به مدلهای زبانی بزرگ در آینده نزدیک راه پیدا میکند یا خیر.